热线电话:0755-23712116

邮箱:contact@shuangyi-tech.com

地址:深圳市宝安区沙井街道后亭茅洲山工业园工业大厦全至科技创新园科创大厦2层2A

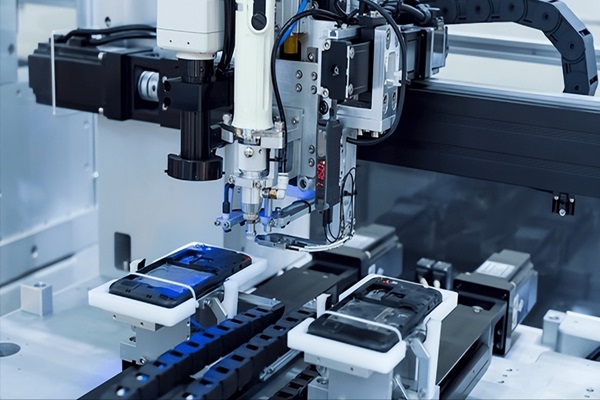

在工业自动化领域,机器视觉对位技术是实现精密制造的核心环节,其本质是通过光学成像与算法解析,精确计算目标物体的位置和姿态偏差,并引导执行机构完成校正。根据应用场景的精度需求、物体尺寸和环境约束,业界发展出多种对位模型,主要可分为自对位模型和映射对位模型两大类。

自对位模型:单相机高效定位

自对位模型通过机械定位确保目标物体位置固定,仅需在对象端(待调整物体)设置相机进行位置纠偏。其核心流程包括:示教模板位置→实时计算偏移量→机械纠偏→完成贴合。根据标记点(Mark点)数量与布局,主要分为以下类型:

1. 单Mark点模型

通过识别单个Mark点(通常为产品中心)计算平移偏移量,适用于小尺寸刚性物体或低精度场景,如小家电组装。

2. 双Mark点模型

识别物体长边或对角线上的两个Mark点,通过中点计算平移,连线计算旋转角度,精度提升至±0.08mm。适用于角度敏感的电路板贴合。

3. 四Mark点模型

以矩形四角为Mark点,通过对角线交点和角度平均值计算位姿,精度达±0.05mm。常见于高精度要求的电子元件装配。

4. 多相机扩展模型

针对大尺寸物体(如车载屏幕),采用双相机或四相机协同,通过虚拟拼接实现全域定位,保持±0.05mm精度。丝印领域专用的抓边模型(四/五相机)甚至可达±0.02mm,通过测量四条边距实现直角/弧角屏幕的精密对位。

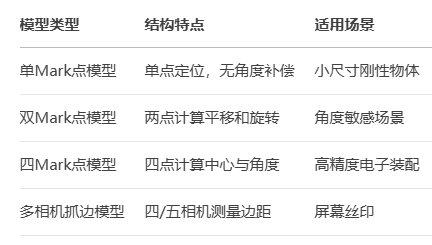

表:常见自对位模型性能对比

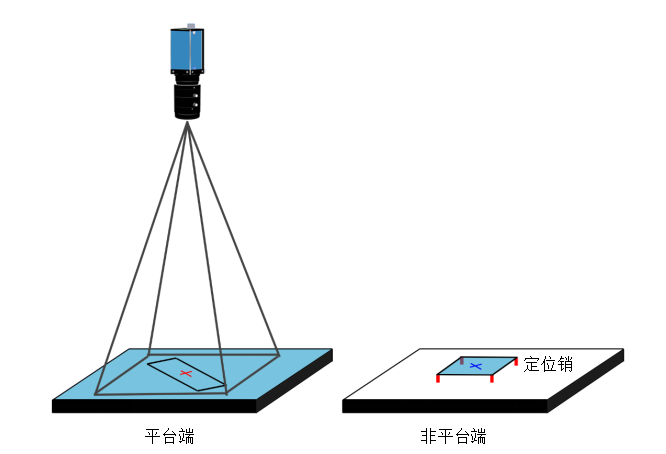

映射对位模型:动态坐标转换

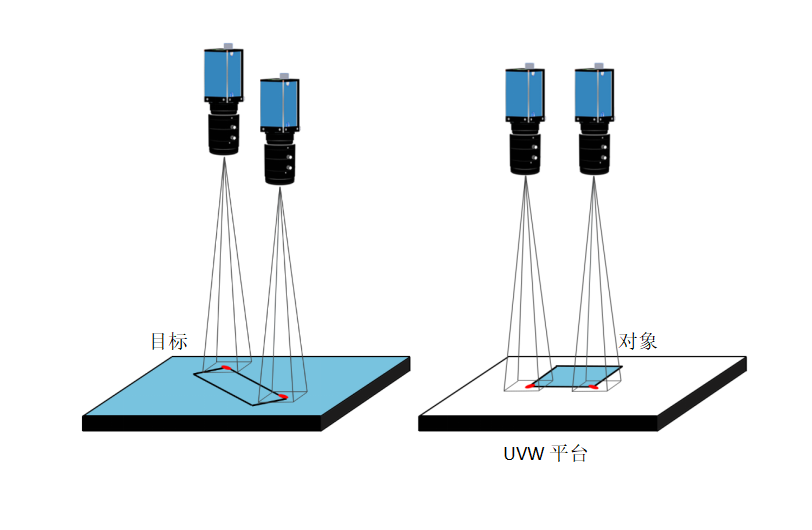

当目标端与对象端位置均不固定时,需采用映射对位模型。该模型通过多相机建立空间映射关系,将目标坐标转换至对象坐标系:

单目双Mark映射:目标端与对象端各设一个相机,通过Mark点角度差计算偏移,精度±0.05mm,适用于FPC与钢片贴合。

多Mark模型:如八Mark映射(四相机方案),通过四个角点建立映射关系,支持>200mm大尺寸产品(如汽车仪表盘),精度±0.05mm。

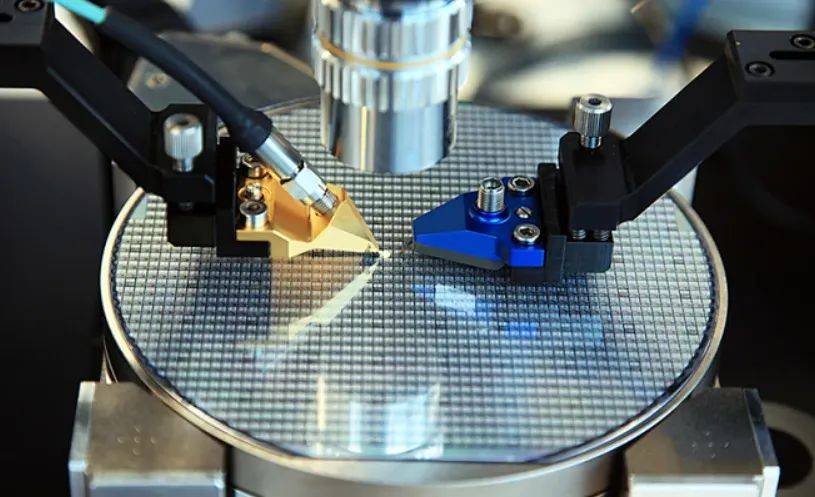

机器视觉对位技术已渗透至高端制造全链路:在半导体领域,双CCD与UVW平台组合实现微米级对准;在折叠屏产线,多相机抓边模型确保转轴区银浆的高精度印刷;未来趋势聚焦于多模态融合与自适应学习:结合深度学习预测材料形变,实现热膨胀实时补偿;通过强化学习优化匹配路径,如分级匹配算法将粗匹配时间缩短40%,精匹配精度提升至99.5%。随着算法与硬件的协同进化,机器视觉对位技术将持续推动精密制造向“零缺陷”目标迈进。

机器视觉对位中的常见模型与技术原理

在工业自动化领域,机器视觉对位技术是实现精密制造的核心环节,其本质是通过光学成像与算法解析,精确计算目标物体的位置和姿态偏差,并引导执行机构完成校正。根据应用场景的精度需求、物体尺寸和环境约束,业界发展出多种对位模型,主要可分为自对位模型和映射对位模型两大类。

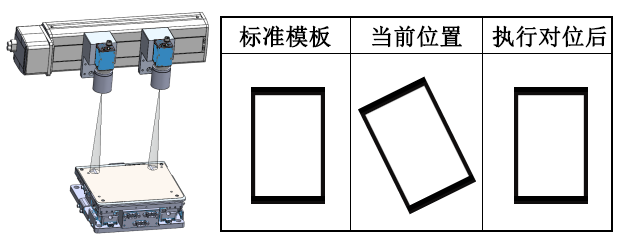

自对位模型:单相机高效定位

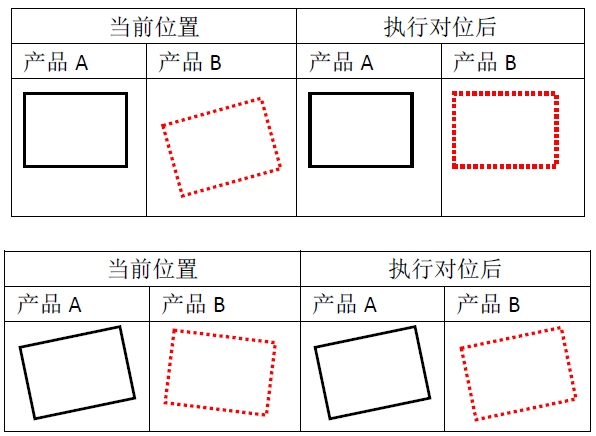

自对位模型通过机械定位确保目标物体位置固定,仅需在对象端(待调整物体)设置相机进行位置纠偏。其核心流程包括:示教模板位置→实时计算偏移量→机械纠偏→完成贴合。根据标记点(Mark点)数量与布局,主要分为以下类型:

1. 单Mark点模型

通过识别单个Mark点(通常为产品中心)计算平移偏移量,适用于小尺寸刚性物体或低精度场景,如小家电组装。

2. 双Mark点模型

识别物体长边或对角线上的两个Mark点,通过中点计算平移,连线计算旋转角度,精度提升至±0.08mm。适用于角度敏感的电路板贴合。

3. 四Mark点模型

以矩形四角为Mark点,通过对角线交点和角度平均值计算位姿,精度达±0.05mm。常见于高精度要求的电子元件装配。

4. 多相机扩展模型

针对大尺寸物体(如车载屏幕),采用双相机或四相机协同,通过虚拟拼接实现全域定位,保持±0.05mm精度。丝印领域专用的抓边模型(四/五相机)甚至可达±0.02mm,通过测量四条边距实现直角/弧角屏幕的精密对位。

表:常见自对位模型性能对比

映射对位模型:动态坐标转换

当目标端与对象端位置均不固定时,需采用映射对位模型。该模型通过多相机建立空间映射关系,将目标坐标转换至对象坐标系:

单目双Mark映射:目标端与对象端各设一个相机,通过Mark点角度差计算偏移,精度±0.05mm,适用于FPC与钢片贴合。

多Mark模型:如八Mark映射(四相机方案),通过四个角点建立映射关系,支持>200mm大尺寸产品(如汽车仪表盘),精度±0.05mm。

机器视觉对位技术已渗透至高端制造全链路:在半导体领域,双CCD与UVW平台组合实现微米级对准;在折叠屏产线,多相机抓边模型确保转轴区银浆的高精度印刷;未来趋势聚焦于多模态融合与自适应学习:结合深度学习预测材料形变,实现热膨胀实时补偿;通过强化学习优化匹配路径,如分级匹配算法将粗匹配时间缩短40%,精匹配精度提升至99.5%。随着算法与硬件的协同进化,机器视觉对位技术将持续推动精密制造向“零缺陷”目标迈进。

机器视觉对位中的常见模型与技术原理

在工业自动化领域,机器视觉对位技术是实现精密制造的核心环节,其本质是通过光学成像与算法解析,精确计算目标物体的位置和姿态偏差,并引导执行机构完成校正。根据应用场景的精度需求、物体尺寸和环境约束,业界发展出多种对位模型,主要可分为自对位模型和映射对位模型两大类。

自对位模型:单相机高效定位

自对位模型通过机械定位确保目标物体位置固定,仅需在对象端(待调整物体)设置相机进行位置纠偏。其核心流程包括:示教模板位置→实时计算偏移量→机械纠偏→完成贴合。根据标记点(Mark点)数量与布局,主要分为以下类型:

1. 单Mark点模型

通过识别单个Mark点(通常为产品中心)计算平移偏移量,适用于小尺寸刚性物体或低精度场景,如小家电组装。

2. 双Mark点模型

识别物体长边或对角线上的两个Mark点,通过中点计算平移,连线计算旋转角度,精度提升至±0.08mm。适用于角度敏感的电路板贴合。

3. 四Mark点模型

以矩形四角为Mark点,通过对角线交点和角度平均值计算位姿,精度达±0.05mm。常见于高精度要求的电子元件装配。

4. 多相机扩展模型

针对大尺寸物体(如车载屏幕),采用双相机或四相机协同,通过虚拟拼接实现全域定位,保持±0.05mm精度。丝印领域专用的抓边模型(四/五相机)甚至可达±0.02mm,通过测量四条边距实现直角/弧角屏幕的精密对位。

表:常见自对位模型性能对比

映射对位模型:动态坐标转换

当目标端与对象端位置均不固定时,需采用映射对位模型。该模型通过多相机建立空间映射关系,将目标坐标转换至对象坐标系:

单目双Mark映射:目标端与对象端各设一个相机,通过Mark点角度差计算偏移,精度±0.05mm,适用于FPC与钢片贴合。

多Mark模型:如八Mark映射(四相机方案),通过四个角点建立映射关系,支持>200mm大尺寸产品(如汽车仪表盘),精度±0.05mm。

机器视觉对位技术已渗透至高端制造全链路:在半导体领域,双CCD与UVW平台组合实现微米级对准;在折叠屏产线,多相机抓边模型确保转轴区银浆的高精度印刷;未来趋势聚焦于多模态融合与自适应学习:结合深度学习预测材料形变,实现热膨胀实时补偿;通过强化学习优化匹配路径,如分级匹配算法将粗匹配时间缩短40%,精匹配精度提升至99.5%。随着算法与硬件的协同进化,机器视觉对位技术将持续推动精密制造向“零缺陷”目标迈进。

热线电话:0755-23712116

邮箱:contact@shuangyi-tech.com

地址:深圳市宝安区沙井街道后亭茅洲山工业园工业大厦全至科技创新园科创大厦2层2A